I juli 2025 genomförde säkerhetsbolaget Anagram en nationell enkät med 500 heltidsanställda i USA. Resultaten pekar på en snabb ökning av AI-användning på arbetsplatserna – men också på beteenden som kan utsätta organisationer för betydande risker.

Viktiga resultat från undersökningen

-

78 % av de anställda använder redan AI-verktyg som ChatGPT, Gemini och Copilot – även där arbetsgivaren inte satt upp tydliga riktlinjer.

-

58 % erkänner att de klistrat in känslig information i AI-system, bland annat kunddata, finansiella uppgifter och interna dokument.

-

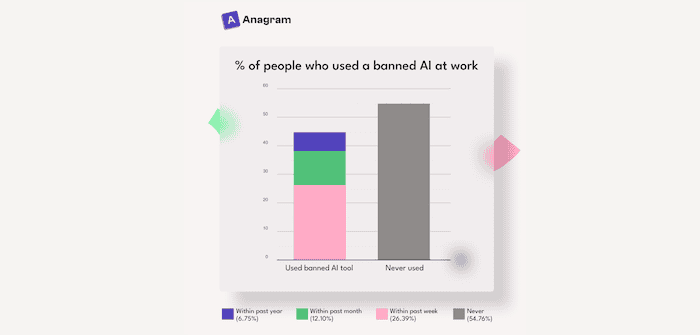

45 % säger att de använt förbjudna AI-verktyg i arbetet.

-

40 % uppger att de medvetet skulle bryta mot företagets policy om det innebär att de kan lösa en uppgift snabbare.

Ett växande säkerhetsproblem

Undersökningen publiceras samtidigt som den amerikanska cybersäkerhetsmyndigheten CISA står inför stora budgetnedskärningar, vilket riskerar att minska myndighetens möjligheter att driva breda säkerhetskampanjer.

– ”Vår undersökning gör det tydligt: medarbetare är beredda att byta efterlevnad mot bekvämlighet. Det borde vara en väckarklocka för alla företag,” säger Harley Sugarman, grundare och vd på Anagram.

Så kan företag agera

Anagram menar att lösningen inte är hårdare förbud, utan mer relevant och engagerande säkerhetsträning. Företag behöver flytta bort från årliga standardutbildningar och istället erbjuda:

-

Kortare videor som integreras i arbetsflödet

-

Interaktiva övningar och uppgifter

-

Kontinuerlig utbildning som följer nya hot

Sugarman betonar att medarbetare inte ska ses som en svag länk, utan som en första försvarslinje – förutsatt att de får rätt verktyg och kunskap.

📌 Källa: Anagram Security